就在我們認為重返水面是安全的時候,隨著雇主根據人工智能視頻和基于游戲的求職者“就業前”評估做出雇用決定,平等就業機會就出現了新的威脅。

電子前沿基金會(Electronic Frontier Foundation)是總部位于華盛頓特區的非營利研究中心, 近要求聯邦通信委員會(FCC)對位于猶他州的招聘公司HireVue進行調查,該公司旨在通過在線“視頻采訪”來評估求職者的工作資格”或“基于游戲的挑戰”。

根據其網站,HireVue在 擁有700多個客戶,其中包括《財富》 100強公司的三分之 以上,以及聯合利華,希爾頓,摩根大通,達美航空,沃達豐,嘉年華郵輪公司和高盛等 品牌。該公司表示,它已經主持了超過 千萬次的按需采訪和 百萬次評估。

EFF的投訴是在 近幾年的 波訴訟之后發生的,這些訴訟指控雇主正在通過將軟件專門針對年輕人的互聯網招聘廣告定位為雇主,使用軟件算法來歧視年齡較大的工人。

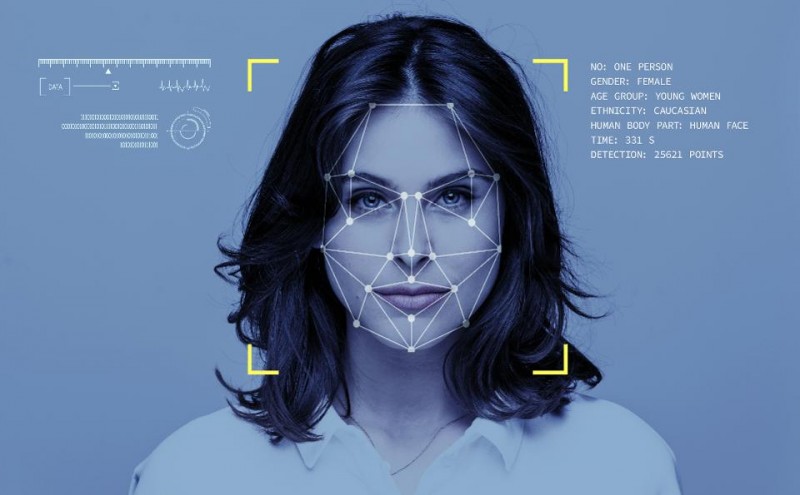

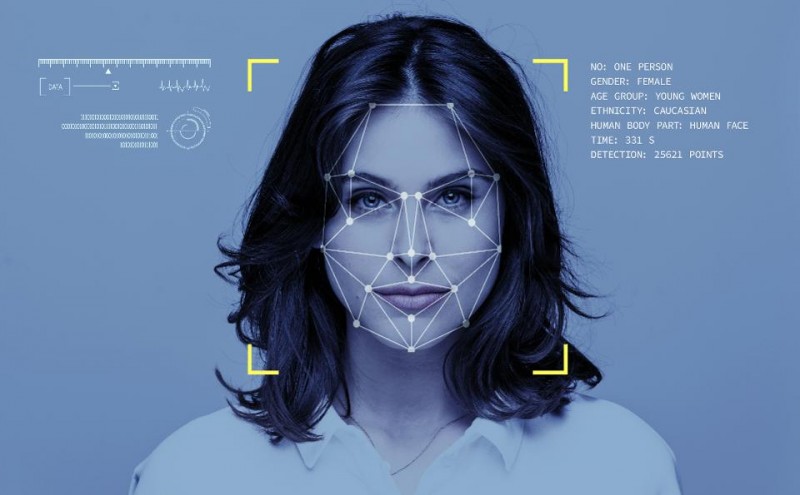

HireVue使用專有算法評估候選人視頻采訪中的“成千上萬個數據點”,包括候選人的“語調”,“拐點”和“情緒”。這些數據點和其他數據點輸入到“預測算法”中,以比較候選人與公司的 佳表現。

HireVue表示,其基于視頻的算法評估提供了“對諸如社交智能(人際交往能力),溝通能力,人格特質和整體工作能力等屬性的出色洞察力。”

EFF指出,HireVue的“業務實踐所產生的結果是有偏見,無法證明且不可復制的。”

電子游戲和老年工人

EFF的投訴重點在于對婦女和少數族裔的潛在偏見,但對于年長工人,使用基于視頻游戲的評估的概念似乎尤其令人懷疑。

電子游戲玩 的平均年齡在30年代中期。許多年齡較大的工人不玩電子游戲,而且年齡較大的女性可能比男性少。即使他們有,他們的反應也可能比熟練的年輕玩 慢。

HireVue的 席技術官Loren Larsen在 份新聞稿中指出,基于游戲的評估可以衡量“情緒智商”,并且“基于對認知能力的理解,使招聘經理能夠更多地了解候選人的能力。”

視頻采訪會懲罰“開箱即用”的候選人嗎?

EFF說,HireVue“從求職者那里收集面部數據,以評估情緒和性格表現”。它說所謂的“面部動作單元”占應聘者分數的29%。

但是,HireVue的算法如何評估那些患有抑郁癥或非英語母語人士的超重候選人?那么自閉癥患者傾向于注視人們的嘴巴并避免直接的眼神交流呢?

HireVue在9月發布了 份新聞稿,宣布它已與非營利組織Integrate Autism Employment Advisors合作,該公司幫助公司招聘“自閉癥 域的合格專業人員”。IntegrateAutism網絡中的600名候選人將接受如何使用HireVue平臺的培訓。如果HireVue的算法不懲罰自閉癥候補者,那么將需要進行這樣的努力。

EFF指出,馬里蘭大學羅伯特·史密斯商學院告訴學生,準備進行AI面試:“機器人將您與現有的成功案例進行了比較;他們不會尋找現成的候選人。”

EFF指出,在得知歷史就業數據優 考慮男性候選人而不是女性之后,亞馬遜放棄了AI招聘工具。在這種情況下,系統會對簡歷進行懲罰,其中包括“婦女” 詞和所有女子大學的名稱。EFF認為,真正判斷招聘算法是否公正的唯 方法是“將其關閉,并使用其他條件聘用某人,以確定他們是否達到或不符合相同的績效標準。”

該算法是秘密

重要的是,HireVue的算法是秘密的,因此公眾無法得知它是否歧視年齡較大的工人,婦女,殘疾人和少數民族等。EFF說,HireVue拒 向求職者提供評估分數。

EFF指控HireVue違反了《聯邦貿易通訊法》,因為它缺乏支持其主張的“合理依據”,并且無法為其秘密算法評估的正常運行負責。EFF還對HireVue的論點提出異議,該論點是HireVue不使用面部識別技術進行身份識別,這被認為違反了FTC法案。

EFF稱,HireVue的平臺也未達到由經濟合作與發展組織(OECD)的36個成員國(包括美國)批準的AI原則中規定的基于AI決策的 低標準。每個人都有權知道與他們有關的AI決策的依據,只有在對其風險進行充分評估之后才可以部署AI系統,并且機構必須確保AI系統不會反映出不公平的偏見。